Cykl poświęcony kondycji systemów VALORANT – toksyczność na czacie głosowym i tekstowym

Artykuł ten jest częścią serii poświęconej dogłębnej analizie tematów związanych z kwestiami gry rankingowej / dynamiki społeczności i rozgrywki w VALORANT. Więcej o tym cyklu dowiecie się tutaj.

Witajcie ponownie! Z tej strony kłaniają się Sara i Brian, członkowie zespołu ds. dynamiki społeczności i rozgrywki w VALORANT. Mamy dla was porcję aktualności na temat szykujących się prac. Temat nie należy do prostych, więc od razu się za niego zabierzmy. Dzisiaj porozmawiamy o nadużyciach środków komunikacji w VALORANT i naszej strategii rozwiązania tego problemu.

WPROWADZENIE – GENEZA PROBLEMU

Toksyczność komunikacji obejmuje zjawiska, które uważamy za niepożądane zachowania na czacie głosowym i tekstowym w grze. Chociaż nie jesteśmy w stanie całkowicie wykorzenić indywidualnego złego zachowania, możemy przy użyciu systemów gry podejmować próby zniechęcania graczy do stosowania obelg, gróźb, nękania lub przekleństw. Można również promować zachowania sprzyjające pozostałym osobom tworzącym społeczność.

Jak już wspomnieliśmy, dokładamy wszelkich starań, aby być awangardą pozytywnych, obejmujących całą społeczność zmian, które są wycelowane w toksyczną komunikację podczas gry. Jesteśmy przekonani, że nastąpił zdrowy postęp w tym obszarze, widzimy jednak, że jest jeszcze wiele do zrobienia.

Chociaż nie istnieje żadne panaceum na tę bolączkę, chcemy przybliżyć wam niektóre podjęte przez nas działania (jak również ich wymierne efekty), a także dodatkowe kroki, które zamierzamy poczynić, aby zapewnić wam lepsze wrażenia z czatu tekstowego i głosowego w VALORANT.

CO DO TEJ PORY ZROBILIŚMY?

Na początek omówmy nasze dotychczasowe wysiłki. Jeśli chodzi o niepożądaną komunikację w naszej grze, istnieją dwie główne formy jej wykrywania, na których polegamy.

Uwagi graczy

Pierwszą formą wykrywania są uwagi graczy, a konkretniej – wysyłane zgłoszenia! Gorąco wszystkich zachęcamy do zgłaszania złego zachowania (czy to będą nadużycia na czacie, czy przypadki bycia AFK lub celowe przegrywanie), między innymi dlatego, że czynnie monitorujemy i wykorzystujemy te dane do nakładania kar.

Dla jasności: to nie oznacza, że każda zgłoszona osoba zostanie ukarana. Szukamy graczy, którzy notorycznie łamią zasady i nakładamy kary o stopniowanej surowości: począwszy od ostrzeżeń aż po definitywne bany (w przypadku skrajnie złych zachowań).

Przy okazji omawiania kwestii AFK w VALORANT rozmawialiśmy o stworzeniu „ocen” zachowań graczy. Wprowadziliśmy również wewnętrzną „ocenę komunikacji” każdego gracza VALORANT, aby szybko rozprawiać się z osobami, które notorycznie łamią zasady.

Z drugiej zaś strony niektórzy piszą i mówią rzeczy mieszczące się w kategorii wykroczeń, wobec których stosujemy politykę „zero tolerancji”. Mowa o wypowiedziach, które są dla nas oczywistą wskazówką, że nie chcemy w VALORANT gracza popełniającego takie wykroczenie. Gdy otrzymujemy zgłoszenia użycia takiego języka, natychmiast wymierzamy surową karę. (Obecnie nakładamy je po zakończeniu meczu – później rozwiniemy ten temat).

Lista zablokowanych słów

Wielu z was zapewne przekonało się, że automatyczne rozpoznawanie tekstu nie jest idealne (gracze znaleźli dość „kreatywne” sposoby na obejście naszych systemów). Dlatego też czasem się zdarzy, że słowa mieszczące się w kategorii „zero tolerancji” nie zostaną przez nas wykryte. Z tego powodu ostatnio wprowadziliśmy „listę zablokowanych słów” umożliwiającą ręczne filtrowanie słów i fraz, których nie chcecie widzieć w grze.

Pełni ona dwie funkcje:

Po pierwsze, mając świadomość, że nasze systemy automatycznego wykrywania nie są idealne, chcemy oddać część sterów w wasze ręce, abyście mogli filtrować niepożądaną komunikację w grze. Po drugie, w kolejnych wersjach systemu planujemy zawrzeć słowa wyfiltrowane przez was przy użyciu listy zablokowanych słów (dlatego korzystanie z listy zablokowanych słów spowoduje w pewien sposób ulepszenie automatycznego wykrywania w przyszłości!).

JAKIE BYŁY REZULTATY?

Jak dotąd wyjaśniliśmy wam część podjętych przez nas działań w celu wykrywania toksyczności w VALORANT, wymierzania za nią kar oraz łagodzenia jej skutków. To tylko wierzchołek góry lodowej i jeszcze długa droga przed nami. Przyjrzyjmy się jednak niektórym rezultatom naszych przedsięwzięć.

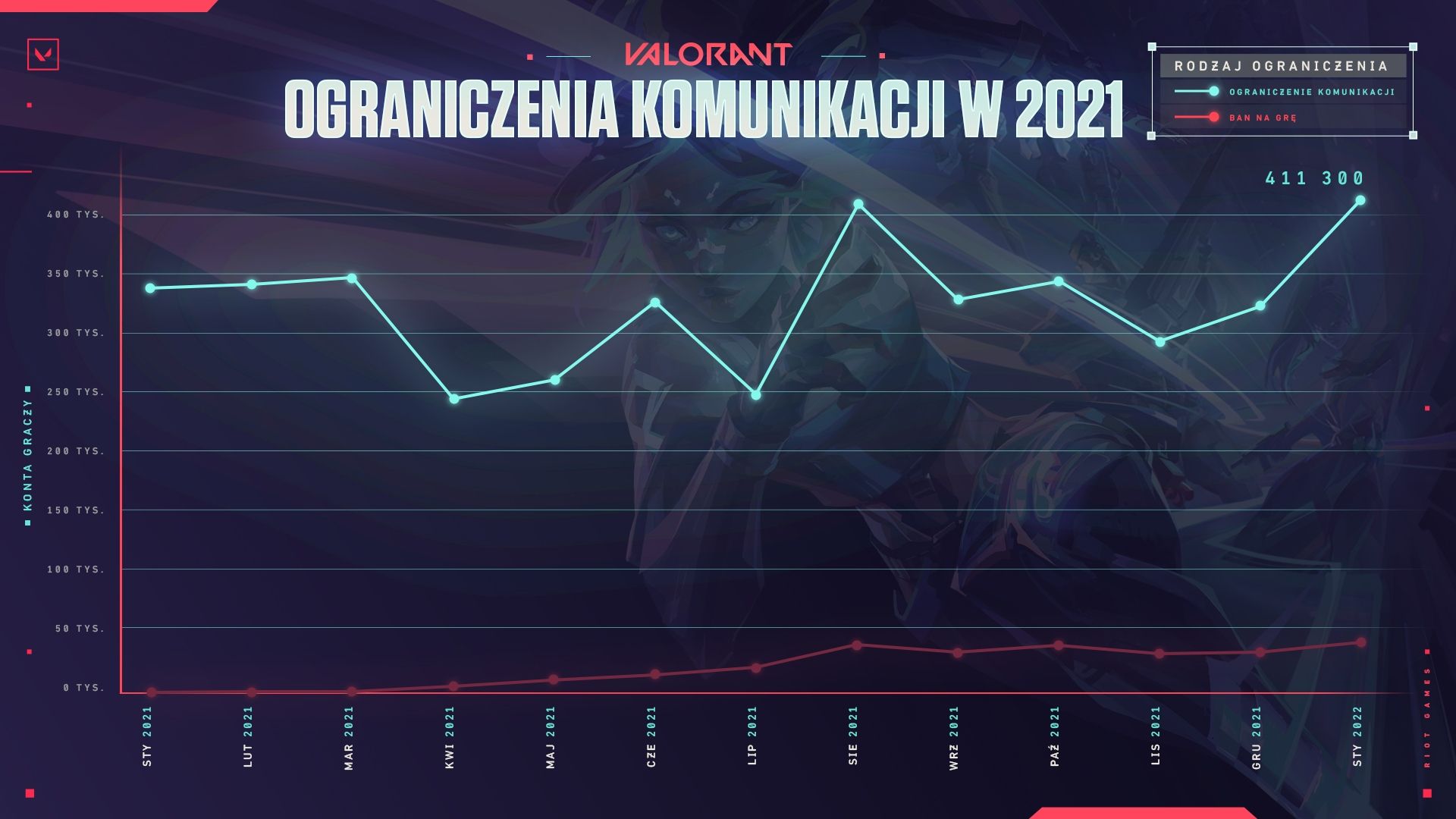

Wyciszanie czatów

Pierwszym jest wyciszanie czatów – najpowszechniejsza forma pierwszej kary wymierzanej przez nas za niepokojącą komunikację tekstową lub głosową. Tylko w styczniu nałożyliśmy ponad 400 000 ograniczeń czatu tekstowego i głosowego w postaci wyciszenia. Są one automatycznie aktywowane, gdy gracz napisze na czacie coś, co uznamy za nadużycie lub gdy wraz z upływem czasu nagromadziło się wystarczająco dużo zgłoszeń (od różnych graczy z różnych gier), dzięki którym mamy sporą pewność, że ta osoba nadużywa czatu tekstowego i/lub głosowego.

Ale na tym jeszcze nie koniec! Miejcie na uwadze, że pracujemy nad ulepszeniem tego modelu, aby bez cienia wątpliwości wykrywać więcej słów, które obecnie mogą umykać systemowi. Będziemy nieustannie dążyć do usprawnień na tym froncie.

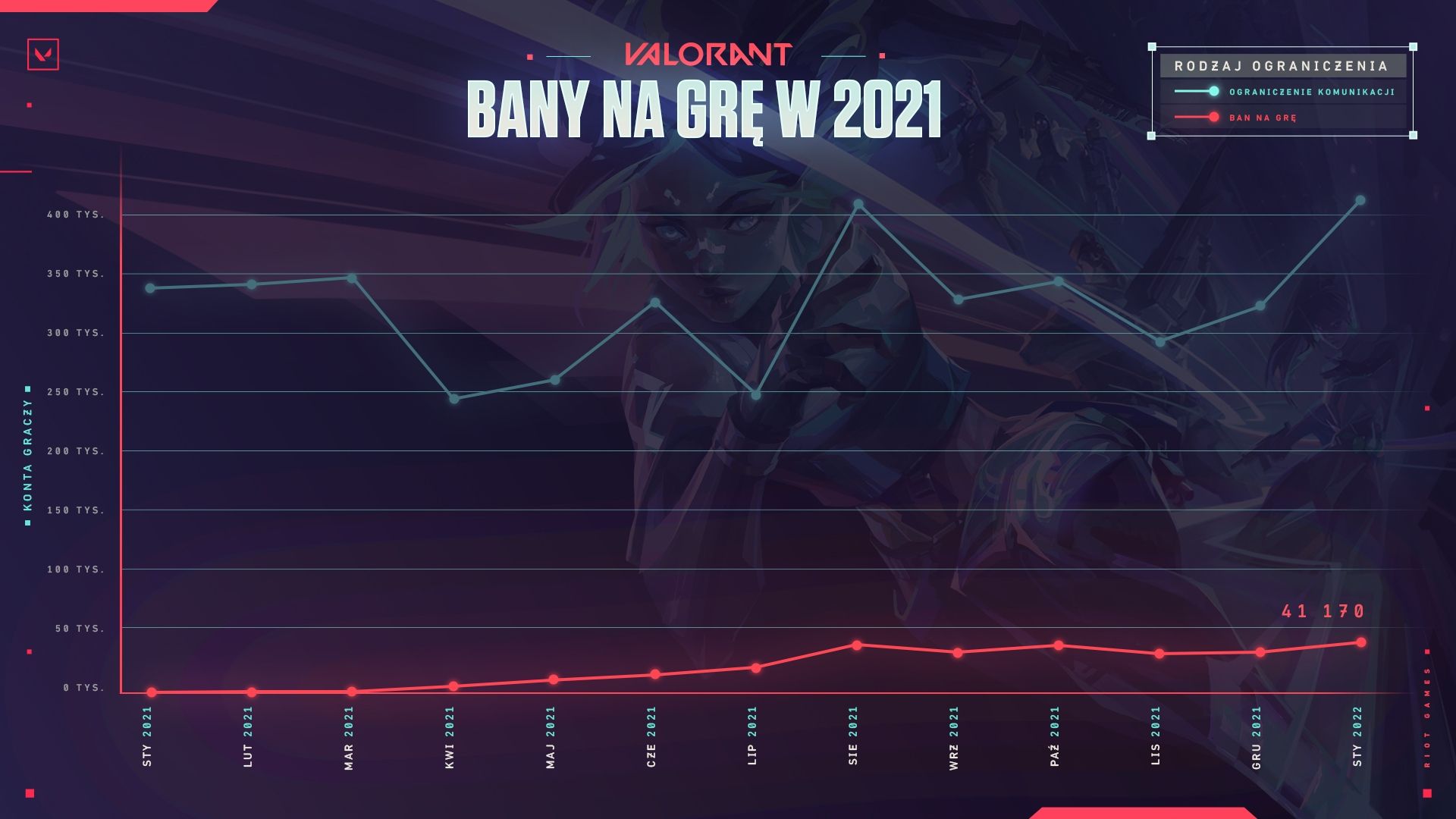

Ograniczenia dotyczące gry

Następne w kolejności są ograniczenia gry. Są to bany nakładane przez nas na konta użytkowników, którzy dopuszczają się licznych, powtarzających się wykroczeń polegających na toksycznej komunikacji. Takie bany mogą trwać od kilku dni (za drobniejsze naruszenia dokonywane przez osoby, które mają ich stosunkowo niewiele na swoim koncie) do roku (dla osób, które notorycznie naruszają zasady). Bany na stałe są zarezerwowane dla wyjątkowo poważnych i/lub powtarzających się zachowań.

Liczba tych banów nie rosła w VALORANT mniej więcej do połowy ubiegłego roku (chcieliśmy mieć pewność, że są w pełni uzasadnione). W styczniu nałożyliśmy ponad 40 000 banów.

Ostatnia kwestia, którą chcemy się z wami podzielić: powyższe liczby obejmują zachowania, które wychwyciliśmy i za które nałożyliśmy kary. Niekoniecznie jednak świadczą o tym, że w efekcie zmniejszyła się toksyczność w VALORANT. W rzeczywistości, gdy przeprowadziliśmy ankietę wśród graczy, zauważyliśmy, że częstotliwość, z jaką stykają się z nękaniem w naszej grze, nie spadła w znaczący sposób. W wielkim skrócie: wiemy, że dotychczas wykonaliśmy, w najlepszym wypadku, podstawową pracę i że czeka jej nas znacznie więcej w 2022 roku i kolejnych latach.

Będziemy na różne sposoby angażować graczy w bieżącym roku, aby lepiej zrozumieć, co możemy usprawnić. Zadbamy o przejrzystość w informowaniu was o postępach w tworzonej przez nas technologii oraz o tym, co o niej myślimy i w jakim kierunku ona zmierza, abyście mogli zgłaszać kolejne uwagi.

JAKIE DZIAŁANIA MAMY W PLANACH?

Wiemy oczywiście, że jest więcej do zrobienia. Dlatego chcemy zdradzić wam nieco szczegółów dotyczących naszych aktualnych działań:

- Ogólnie surowsze kary w istniejących systemach: Aby niektóre z istniejących już systemów wykrywały toksyczność i łagodziły jej skutki, w trakcie gromadzenia danych poświęciliśmy więcej czasu „zachowawczym” działaniom (chcąc mieć pewność, że wykrywanie nie działa błędnie). Czujemy się znacznie pewniej, jeśli chodzi o te systemy wykrywania, dlatego zaczniemy stopniowo zwiększać surowość kar oraz ich zaostrzanie. Takie posunięcie powinno poskutkować tym, że szybciej zajmiemy się osobami mającymi złe intencje.

- Niezwłoczna moderacja tekstowa w czasie rzeczywistym: Chociaż aktualnie funkcjonuje automatyczne wykrywanie wpisywanych na czacie słów z kategorii „zero tolerancji”, kary są wymierzane dopiero po zakończeniu gry. Obecnie szukamy sposobu na ich natychmiastowe nakładanie.

- Ulepszenia obecnej moderacji głosowej: Aktualnie polegamy na powtarzających się zgłoszeniach od graczy, aby ustalić, czy doszło do nadużycia czatu głosowego. Znacznie trudniej jest wykryć takie przypadki w porównaniu z czatem tekstowym (co często wymaga bardziej „ręcznie sterowanego” procesu). Stopniowo podejmujemy jednak działania zmierzające do wprowadzenia ulepszeń w tym obszarze. Zamiast trzymać wszystko w sekrecie do momentu, w którym uznalibyśmy, że moderacja głosowa jest „idealna” (czyli nigdy), będziemy regularnie publikować newsy na temat zmian i ulepszeń systemu. Miejcie oko na kolejną porcję aktualności mniej więcej w połowie roku.

- Regionalny pilotażowy program testowy: Niedawno nasz turecki zespół wystartował z lokalnym programem pilotażowym, aby podjąć próbę skuteczniejszej walki z toksycznością w ich regionie. Ostatecznie rzecz sprowadza się do tego, żeby stworzyć system zgłoszeń obsługiwany przez pracowników działu Wsparcia Gracza (nadzorujących wpływające zgłoszenia dotyczące wyłącznie zachowań graczy), którzy będą podejmować określone działania zgodne z ustalonymi wytycznymi. Program ten znajduje się zdecydowanie w fazie beta. Jeśli jednak okaże się wystarczająco obiecujący, jakaś jego wersja być może pojawi się w innych regionach.

I ostatnia rzecz, o której mówiliśmy przy okazji tematu AFK: zamierzamy regularniej informować was zarówno o wprowadzanych przez nas zmianach, jak i o ich skutkach. Dzięki temu cały czas będziemy brać odpowiedzialność za nasze deklaracje, a wy – mamy nadzieję – będziecie na bieżąco z tematem!

JESZCZE KILKA SŁÓW O KOMUNIKACJI GŁOSOWEJ

Wiemy, jakiej frustracji doświadcza gracz i jak bezradny się czuje, zarówno podczas gry, jak i po niej, gdy styka się z toksycznością – zwłaszcza za pośrednictwem komunikacji głosowej. Takie sytuacje nie tylko zagrażają wszystkim pozytywom VALORANT, ale i przynoszą trwałe szkody naszym graczom oraz całej społeczności. Zniechęcanie do toksycznych zachowań w komunikacji głosowej i nakładanie kar stanowią wspólne wysiłki firmy Riot jako całości. Dokładamy wszelkich starań, aby każdy czerpał więcej radości z gry.

Ocena danych głosowych

W zeszłym roku Riot zaktualizował Informację o polityce prywatności i Warunki świadczenia usług, aby zyskać możliwość rejestrowania oraz oceny komunikacji głosowej zgłoszonej jako uciążliwe zachowanie. Zaczęliśmy od VALORANT. Obok istniejących systemów gry musimy mieć niepodważalne dowody, dzięki którym sprawdzimy, czy doszło do naruszenia zasad dotyczących zachowań. Pomogą nam one również wytłumaczyć graczom, dlaczego konsekwencją określonego zachowania było zastosowanie kary.

Teraz skupiamy się na uruchomieniu wersji beta systemu oceny danych głosowych w Ameryce Północnej / wyłącznie w języku angielskim. Ma ona ruszyć w dalszej części tego roku. Następnie, gdy poczujemy, że ta technologia jest już odpowiednio dobra, zastosujemy bardziej globalne rozwiązanie. Pamiętajcie, że w ten sposób podejmiemy wstępną próbę pilotażu nowego pomysłu z wykorzystaniem zupełnie nowej technologii, którą aktualnie tworzymy. Zanim więc to rozwiązanie się przyjmie i stanie skutecznym narzędziem w naszym arsenale, minie trochę czasu. Powiadomimy was z odpowiednim wyprzedzeniem o konkretnych planach dotyczących sposobu funkcjonowania tego systemu, zanim zaczniemy gromadzić dane głosowe w jakiejkolwiek postaci.

JAK MOŻECIE NAM POMÓC?

Chcielibyśmy was prosić tylko o to, abyście nadal korzystali z dostępnych systemów. Cały czas zgłaszajcie toksyczne zachowania w grze. Korzystajcie z listy zablokowanych słów, jeśli natraficie na niepożądane treści. Dalej przekazujcie nam swoje uwagi odnośnie do waszych doświadczeń w grze oraz zmian, które chcielibyście zobaczyć. Postępując w ten sposób, pomożecie nam zadbać o to, aby gra w VALORANT była bezpieczniejsza. Jesteśmy wam wdzięczni za tak okazywaną troskę.

Do zobaczenia w kolejnej aktualizacji! Tymczasem śmiało przesyłajcie wszelkie uwagi lub pytania członkom zespołu ds. dynamiki społeczności i rozgrywki, do którego należą:

- Sara „Riot necrotix”

- Brian „Riot South Korea”

- Lydia „Riot Lydia”

- Grace „Riot Gyudon”

- Lub osobie odpowiedzialnej za komunikację