Serie del estado de los sistemas de VALORANT - La toxicidad en los chats de texto y voz

Esta publicación pertenece a una serie de artículos que profundizan en temas relacionados con los sistemas del campo de las dinámicas sociales, competitivas y de jugador de VALORANT. Aquí encontraréis más información sobre la serie.

¡Hola de nuevo! Sara y Brian, miembros del equipo social y de dinámicas de jugador de VALORANT, vuelven con más información sobre el trabajo que tenemos planeado para el futuro próximo. Este tema es bastante complicado, así que vamos a ello. Hoy vamos a hablar sobre el mal uso de los sistemas de comunicación en VALORANT y nuestra estrategia para lidiar con ese problema.

INTRODUCCIÓN - EL PLANTEAMIENTO DEL PROBLEMA

La toxicidad es un comportamiento indeseado tanto en los canales de voz como en el chat de texto. Si bien es cierto que nunca podremos evitar que ciertos individuos opten por comportarse así, sí que podemos intentar disuadiros de insultar, amenazar, acosar o insultar a otros a través de nuestros sistemas del juego. También nos parece que podemos promover el comportamiento responsable.

Como ya hemos dicho antes, estamos decididos a dar ejemplo en lo que respecta a luchar por un futuro mejor en los canales de comunicación de videojuegos en general. Creemos que estamos progresando adecuadamente en este tema, pero somos conscientes de que nos queda mucho trabajo por hacer.

A sabiendas de que no hay fórmula secreta que nos permita acabar con los problemas de toxicidad, queremos explicaros las medidas que hemos tomado (y los resultados que hemos registrado), así como los próximos pasos que daremos para mejorar la experiencia en los chats de texto y voz en VALORANT.

¿QUÉ HEMOS HECHO HASTA AHORA?

Primero vamos a repasar nuestra labor hasta la fecha. Disponemos de dos sistemas principales de detección para identificar la comunicación no deseada en el juego.

Los informes de los jugadores

Las opiniones de los jugadores, y especialmente los informes, son el primero de estos métodos. Uno de los motivos por los que os animamos a informarnos del mal comportamiento (ya sea a través del chat, por inactividad o por sabotaje intencionado) es porque analizamos y empleamos activamente esa información para asignar sanciones.

Por supuesto, eso no quiere decir que cualquiera que reciba un informe acabará sancionado. Buscamos a jugadores reincidentes y vamos administrando suspensiones progresivas que, al principio, no son más que avisos, pero que pueden progresar hasta convertirse en bloqueos totales del juego (cuando las circunstancias lo requieren).

Ya hemos mencionado antes lo de crear "puntuaciones" de comportamiento de los jugadores cuando hablamos sobre los AFK en VALORANT. De forma similar, hemos creado una "puntuación de comunicación" interna para cada jugador de VALORANT, para que así podamos lidiar rápidamente con aquellos que cometan infracciones con regularidad.

Por otro lado, hay ciertas cosas que la gente dice por el chat de texto y voz para las que tenemos tolerancia cero. Este tipo de ofensas graves nos dejan claro inmediatamente que no queremos al jugador o la jugadora en cuestión participando en la comunidad de VALORANT. Cuando vemos informes que incluyen este tipo de lenguaje, pasamos directamente a las penalizaciones más severas (a día de hoy, estas penalizaciones se aplican después de que haya terminado la partida; luego os contaremos más sobre el tema).

Lista de palabras silenciadas

Muchos os habréis dado cuenta de que la detección automática de texto no es perfecta (los jugadores han encontrado formas muy "creativas" de sortear nuestros sistemas), así que, a veces, alguno de estos insultos para los que tenemos tolerancia cero se colarán por los puntos ciegos del sistema. Por este motivo, hemos implementado recientemente una lista de palabras silenciadas que os permitirá filtrar manualmente las palabras y las frases que no queráis encontraros nunca en partida.

Esto cumple dos funciones:

La primera es que, como sabemos que nuestros sistemas de detección automática no son infalibles, queremos otorgar cierta autonomía a los jugadores para que filtren el lenguaje que no quieren ver en partida. La segunda función es que pretendemos utilizar las listas de palabras silenciadas para actualizar nuestro sistema de detección automática en versiones futuras (así que, en cierto modo, usar esa nueva función acabará por mejorar el sistema de detección).

¿QUÉ RESULTADOS HEMOS OBTENIDO?

Hasta el momento, os hemos explicado algunas de las cosas que hemos hecho para detectar, castigar y mitigar la toxicidad en VALORANT. Esto no es más que la punta del iceberg y nos queda mucho trabajo por delante, pero vamos a echar un vistazo a algunos de los resultados de estas medidas.

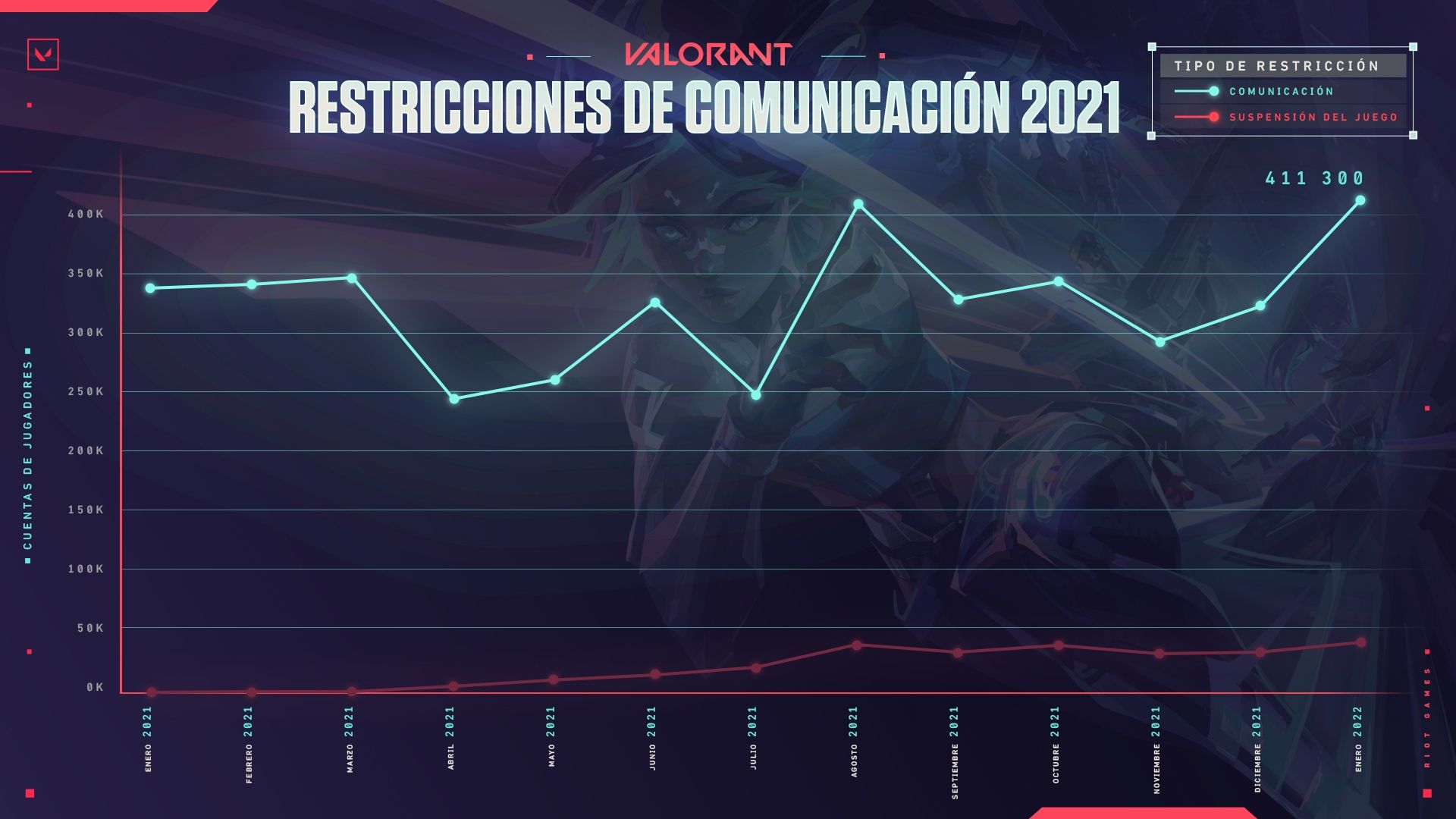

Suspensiones del chat

En primer lugar están las suspensiones del chat, que son la forma más común de sanción inicial que aplicamos cuando detectamos actividad preocupante en el chat de texto o de voz. Solo durante el mes de enero administramos un total de 400 000 restricciones de chat. Estas suspensiones se activan automáticamente cuando un jugador pone algo que consideramos abuso en el chat, y también cuando dicho jugador ha acumulado suficientes informes (de diferentes jugadores en partida distintas) como para que podamos saber con suficiente certeza que está siendo tóxico en los canales de comunicación.

¡Y esto no es todo! Tened en cuenta que estamos trabajando para mejorar el modelo de detección y filtrar cada vez más palabras que aún consiguen colarse por nuestro sistema. Seguiremos tratando de mejorar en este campo.

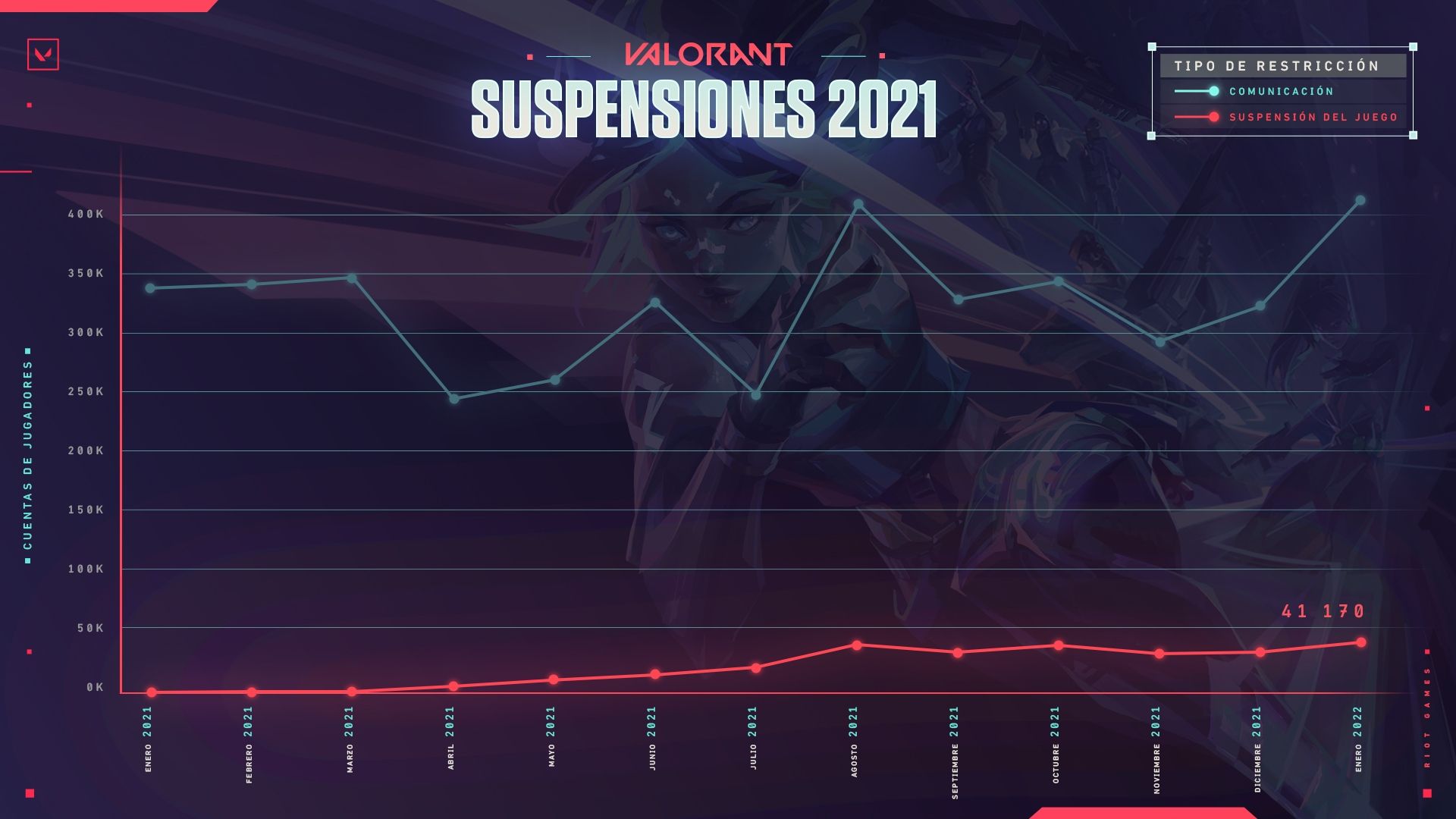

Restricciones del juego

El siguiente paso son las restricciones del juego. Estas suspensiones se aplican a cuentas que muestran tendencias reincidentes de toxicidad en los canales de comunicación. Pueden durar desde unos pocos días (para ofensas menores por parte de jugadores/as sin gran historial de toxicidad) hasta años (para reincidentes crónicos). Las suspensiones permanentes se reservan para el comportamiento más nocivo y reiterado.

Hemos comenzado a impartir este tipo de bloqueos con más frecuencia desde mitad del año pasado, más o menos (queríamos asegurarnos de que eran justificados en todos los casos). En enero, aplicamos un total de 40 000 suspensiones.

Hay un último dato que nos gustaría compartir: las cifras de más arriba son indicadores de comportamientos que hemos detectado y sancionado, pero no significan necesariamente que la toxicidad en las partidas de VALORANT se haya visto reducida. De hecho, cuando encuestamos a los jugadores sobre el tema, averiguamos que la frecuencia con la que se encuentran con acoso y toxicidad en el juego no ha disminuido de forma significativa. En resumen: sabemos que el trabajo que llevamos hecho hasta la fecha no supone más que los cimientos del sistema, y que tenemos mucho que desarrollar en este campo en 2022 y más adelante.

Estamos probando nuevas formas de interactuar con nuestra comunidad durante el próximo año para identificar las áreas que necesitamos mejorar. Nos aseguraremos de ser muy transparentes en lo que respecta a la tecnología que estamos desarrollando y los planes que tenemos en mente. Así, podremos contar con un flujo constante de comentarios por vuestra parte.

¿QUÉ TENEMOS PENSADO HACER?

Tenemos claro que queda mucho trabajo por delante. Por eso, vamos a compartir con vosotros un adelanto de nuestros proyectos actuales:

- Sanciones más estrictas dentro de los sistemas existentes: algunos de los sistemas de detección y sanción de toxicidad eran algo más "conservadores" de lo que nos gustaría inicialmente, para que pudiéramos recopilar datos sin tener miedo de cometer errores de detección. Ahora confiamos mucho más en nuestro sistema de detección, así que comenzaremos a aumentar gradualmente la gravedad y la progresión de dichas sanciones. Esto debería resultar en una gestión más ágil de las personas problemáticas.

- Moderación de texto más inmediata: aunque ahora mismo tenemos un sistema de detección automática de palabras de "tolerancia cero" en el chat, las sanciones resultantes no se aplican hasta que la partida en curso ha terminado. Estamos buscando formas de aplicar suspensiones desde el momento en el que se decide administrarlas.

- Mejoras para la moderación de voz existente: a día de hoy, dependemos de acumular informes de jugadores para determinar si un jugador o una jugadora ha tenido un comportamiento inapropiado en el chat de voz. Es mucho más difícil detectar la toxicidad en el chat de voz (y suele requerir un proceso más manual), pero hemos estado tomando medidas para mejorar. En lugar de guardarnos los avances hasta que contemos con un sistema de moderación de voz que nos parezca "perfecto" (que no va a pasar nunca), vamos a ir publicando actualizaciones sobre las mejoras que implementamos al sistema con regularidad. La próxima actualización sobre el tema llegará a mediados de este año.

- Programa de pruebas regional: Nuestro equipo turco ha puesto en marcha recientemente un programa local que pretende reducir la toxicidad de la región. Consiste, básicamente, en crear una línea operativa con agentes de asistencia al jugador que revisan los informes entrantes relacionados con el comportamiento de los jugadores y toman medidas siguiendo una guía preestablecida. Está en fase de beta temprana pero, si vemos que promete, es posible que una versión de ese sistema acabe llegando al resto de regiones.

Por último, y aunque ya lo mencionamos cuando hablamos sobre inactividad, queremos comprometernos a comunicaros los cambios que implementamos y el resultado de los mismos con mayor regularidad. Es algo que nos recuerda que tenemos unas expectativas que cumplir, y os permite estar al tanto de los avances.

SOBRE EL CHAT DE VOZ

Cuando os encontráis con comportamientos tóxicos, especialmente en el chat de voz, sabemos que puede resultar increíblemente frustrante y haceros sentir muy impotentes tanto en partida como fuera de ella. Es algo que estropea la diversión en VALORANT, y que también puede tener consecuencias serias para nuestros jugadores y nuestra comunidad. Disuadir y penalizar a las personas tóxicas es una misión que incluye a todos los miembros de Riot, y estamos comprometidos a proporcionar una experiencia de juego más agradable para todo el mundo.

Evaluación de voz

El año pasado, Riot actualizó la política de privacidad y los términos de servicio para permitirnos grabar y evaluar la comunicación por voz en los juegos cuando recibimos un informe sobre comportamiento disruptivo, empezando por el caso de VALORANT. Para complementar nuestros sistemas de juego actuales, también necesitamos pruebas claras con las que verificar las infracciones de las políticas de comportamiento antes de tomar medidas, así como para explicar a los jugadores por qué un comportamiento en particular ha resultado en una penalización.

En este momento, nuestro objetivo es lanzar la beta de un sistema de evaluación de voz en Norteamérica que funcionará solo en inglés más adelante este año. Después, pasaremos a buscar una solución a nivel más global cuando sintamos que la tecnología está lista para ampliar horizontes. Recordad que este es nuestro primer intento de materializar una nueva idea con tecnología innovadora y en desarrollo, así que puede que tardemos un tiempo en tenerlo todo listo y convertirla en una herramienta útil para nuestro arsenal. Os iremos contando cómo van nuestros planes para el funcionamiento de este sistema antes de empezar a recopilar datos del chat de voz.

¿CÓMO PODÉIS AYUDARNOS?

Lo único que os pedimos es que utilicéis los sistemas existentes. Seguid informando sobre quien sea tóxico en partida, usad la lista de palabras silenciadas si os encontráis con términos que os molestan en el chat y seguid dejándonos comentarios sobre vuestras experiencias y deseos para el juego, por favor. Con todo esto, nos estáis ayudando a convertir VALORANT en un espacio más seguro, y os estamos muy agradecidos.

¡Nos vemos en la próxima actualización! Mientras tanto, contadnos lo que os parezca de todo esto y planteadles las preguntas que queráis a los miembros del equipo social: